2026/01/16

教育行业如何实现"随时可用"的 GPU 实验室,同时降低 70% 成本

某区域教育网络通过 TensorFusion 池化 GPU 资源,为 AI 课程提供稳定性能并显著降低成本。

"我们有 GPU——但学生每天只用 3 小时,我们却在为 24 小时买单"

某区域教育网络服务 12 所高校、40+ 门 AI 课程,涵盖计算机视觉、扩散模型、机器人仿真等。平台需要为数千名学生提供 GPU 资源,但每次实验课时间短、峰值集中。财务反复追问:"实验室只有上午 10 点和下午 2 点忙,为什么 GPU 账单还这么高?"

三大核心痛点:闲置、冷启动、预算超支

痛点一:24 小时为闲置 GPU 买单

- 每天高峰仅 2–4 小时:实验室只在课表时段繁忙,其余 18–22 小时设备几乎空转。

- 课程间无法共享:每门课倾向于独占"自己的"GPU,账面需求高,整体利用率却上不去。

- 量化影响:两个学期平均 GPU 利用率仅 18–22%——约 80% 的付费算力被浪费。

痛点二:"60 秒开课就绪"曾是空谈

- 教学要求:实验环境须在 60 秒内就绪,否则课程节奏被打断。

- 实际情况:实验环境启动 P95 达 140–180 秒——学生要等 2–3 分钟,课堂节奏被打乱。

- 根因:没有温缓存策略,每次当冷启动处理;按课程独占 GPU 的模式下,预加载难以落地。

痛点三:预算固定,账单却不可控

- 学期预算固定;云端用量一超支就压缩招生和新增 AI 课程。

- 没有可见性:不知道哪些课程、哪些时段在消耗算力,优化只能靠经验。

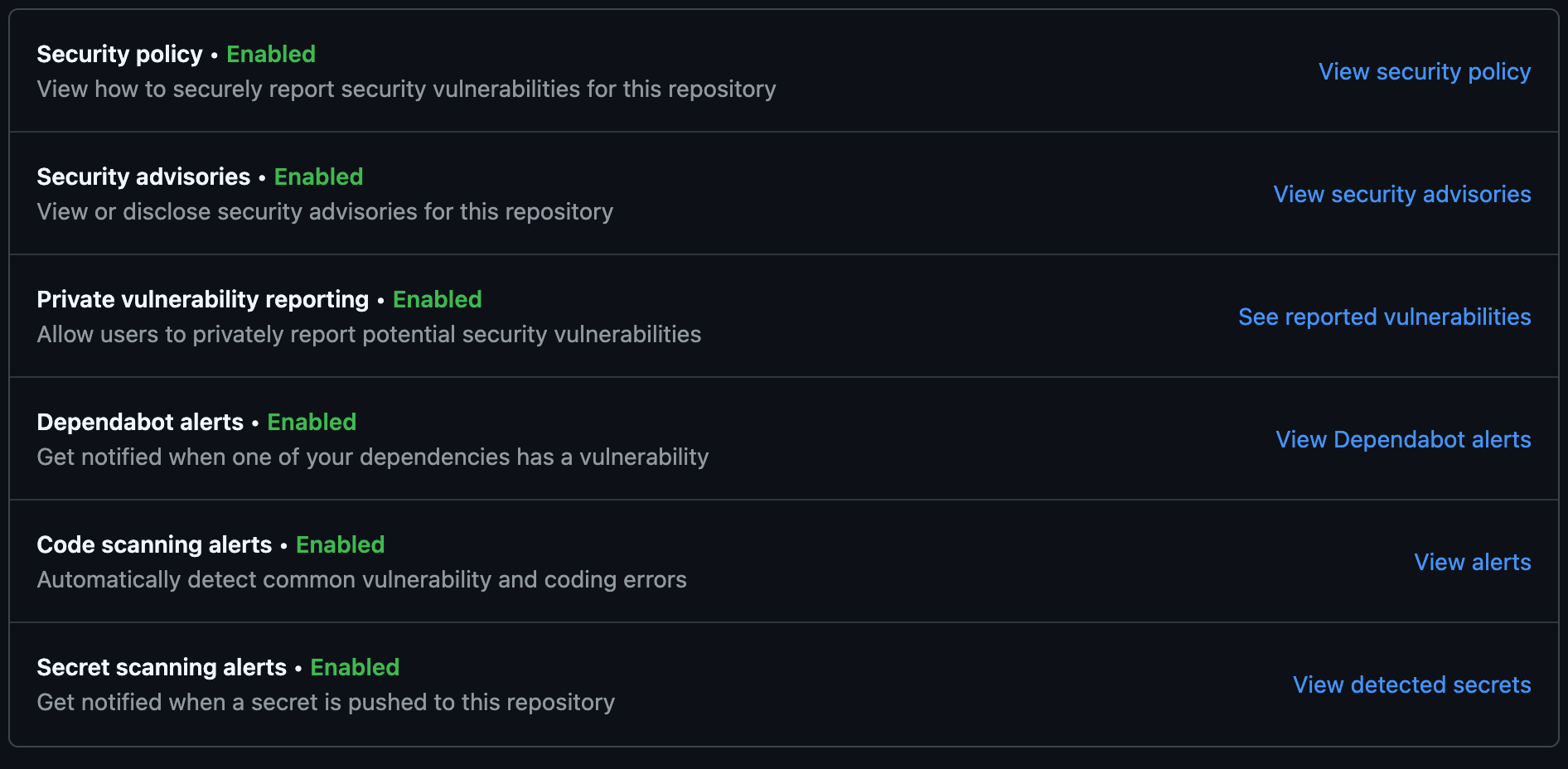

基线指标(引入 TensorFusion 前两个学期):

| 指标 | 基线 |

|---|---|

| 平均 GPU 利用率 | 18–22% |

| 实验环境启动 P95 | 140–180 秒 |

| 高峰并发学生数 | 1,200 |

| 学期 GPU 成本 | 100%(基线) |

TensorFusion 如何对应解决这些痛点

TensorFusion 的 GPU 池化、动态切分 和 按课表调度 直接契合教育的突发需求与严格的"开课就绪"要求。

痛点一(闲置)为何被解决

- 跨校区共享 GPU 资源池,按课程优先级划分——不再"一门课 = N 张独占 GPU"。

- 按使用自动扩缩容,在非上课时段释放闲置算力,不再为长期空转付费。

- GPU 虚拟化与超配 让一张物理卡服务多门轻量实验课;利用率从约 20% 提升到 60%+。

痛点二(冷启动)为何被解决

- 热门课程镜像温缓存预加载,与 LMS/课表打通,到点即热——上课铃响时环境已就绪。

- 轻量推理实验(如图像滤波)使用 动态 GPU 切分,启动更轻;完整 GPU 留给重度训练。

- 双层级服务:低延迟推理层 + 批训练层,让"开课就绪"变成可承诺的 SLA,而不是碰运气。

痛点三(预算)为何被解决

- 公平策略 防止单门课独占资源;支出与真实用量对齐。

- 池化 + 合理规格 在本案例中将学期 GPU 成本降低 约 70%,固定预算能支撑更多学生和课程。

实施要点

- 将 LMS 课表接入 TensorFusion 调度器,实现按时间窗预热。

- 通过策略保证没有单门课长期独占 GPU。

- 双层级服务:低延迟推理层与批训练层。

结果:优化前 vs 优化后

落地一学期后:

| 指标 | 优化前 | 优化后 | 变化 |

|---|---|---|---|

| 平均 GPU 利用率 | 20% | 62% | 约 3× |

| 实验环境启动 P95 | 160 秒 | 48 秒 | 约 70% 更快 |

| 高峰并发 | 1,200 | 2,100 | +75% |

| 学期 GPU 成本 | 100% | 30% | 降低 70% |

| 使用 TensorFusion 前 | 使用 TensorFusion 后 |

|---|---|

| 实验室每天约 3 小时在用,却为 24 小时付费 | 成本约降 70%;算力与上课时间窗对齐 |

| 实验启动 P95 140–180 秒,课程节奏被打断 | 实验启动 P95 48 秒,一分钟内"开课就绪" |

| 利用率 18–22%,课程间无法共享 | 利用率 62%,共享池 + 切分 + 温缓存 |

"我们终于不用为'长期闲置的算力'买单。实验课更快,预算更稳。" — 某高校教学技术负责人

为何 TensorFusion 适合教育场景

教育负载 按课表可预测、按小时却波动大。TensorFusion 的池化与调度匹配 按时间窗的需求 和 按课程优先级的分配,无需每门课独占 GPU。真正的 GPU 虚拟化(显存隔离、超配)和 Kubernetes 原生集成,使在同一批硬件上服务更多学生、60 秒内开课、学期支出可预测——同时成立。

更多文章

邮件列表

加入我们的社区

订阅邮件列表,及时获取最新消息和更新