2026/01/18

公安视频分析如何实现"数据不动、算力动"并降低响应延迟

某市公安局通过 TensorFusion 池化 GPU 资源,实现低延迟告警与更高利用率。

"每个辖区都有 GPU——但 A 区高峰时用不上 B 区的闲置算力"

某市公安局负责城市级视频分析系统,支持实时告警、案件回溯和跨辖区研判。系统要求数据不出辖区,同时需快速响应重大事件。运维反复问:"A 区打满时为什么不能用 B 区的闲置 GPU?"——因为数据合规禁止搬视频;传统方案无法在不搬数据的前提下共享算力。

三大核心痛点:数据合规 vs 算力、割裂、高峰延迟

痛点一:数据合规与算力需求的矛盾

公安系统面临的核心矛盾是数据主权与算力需求的冲突:

- 数据合规要求:视频数据必须严格限制在各自辖区,不能跨区域传输,这是硬性合规要求。

- 算力需求波动:8,000+ 路视频流带来的推理负载极不稳定,不同辖区在不同时段的负载差异巨大。

- 传统方案局限:传统方案只能在每个辖区独立部署GPU资源,无法跨区域共享,导致资源浪费严重。

痛点二:资源割裂导致利用率低下

各辖区独立部署GPU资源,形成"孤岛效应":

- 资源分布不均:部分辖区GPU长期空闲(利用率仅20%),而其他辖区在高峰期GPU满载,任务排队。

- 无法弹性调度:即使相邻辖区有闲置GPU,也无法被其他辖区使用,资源割裂严重。

- 成本浪费:每个辖区都需要按峰值需求配置GPU,但实际平均利用率仅22-30%,大量资源闲置。

痛点三:高峰期延迟影响应急处置效率

重大事件和高峰期是公安系统最需要快速响应的时刻,但此时系统性能反而最差:

- 告警延迟高:高峰期告警P95延迟达到5-7秒,严重影响应急处置的黄金时间。

- 案件回溯排队:历史案件回溯分析需要20-30分钟排队等待,影响案件侦破效率。

- 资源竞争:实时告警、案件回溯、批量分析等任务同时竞争GPU资源,缺乏优先级保障。

痛点四:成本居高不下且难以优化

- 重复投资:各辖区独立采购GPU,无法形成规模效应,采购成本高。

- 运维复杂:分散的GPU资源需要各辖区独立运维,人力成本高。

- 扩展困难:新增辖区或扩容时,需要重新采购和部署,周期长、成本高。

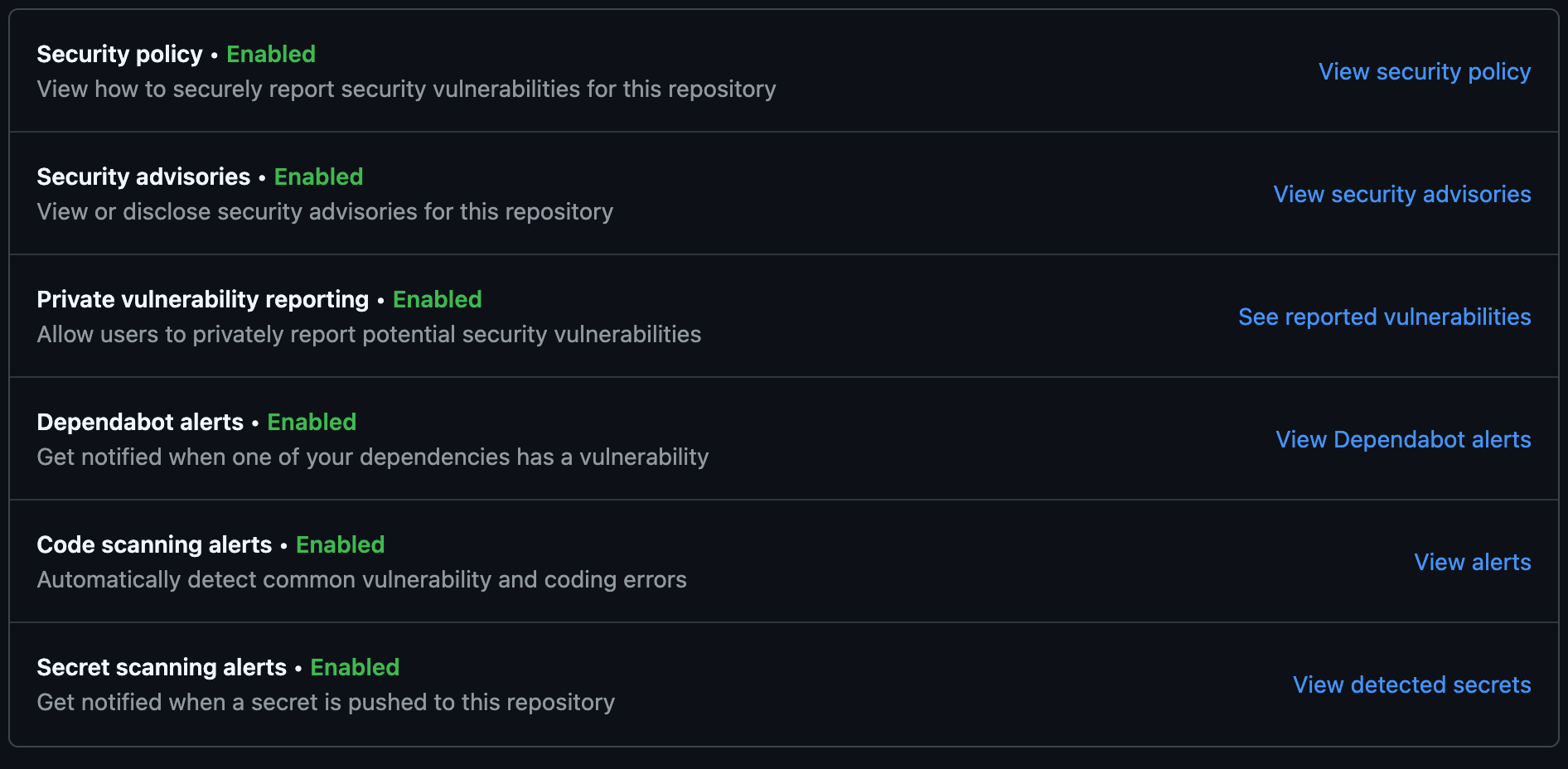

基线指标:

| 指标 | 基线 |

|---|---|

| 告警 P95 延迟 | 5–7 秒 |

| GPU 利用率 | 22–30% |

| 案件回溯排队时间 | 20–30 分钟 |

| 年度 GPU 成本 | 100%(基线) |

| 跨辖区资源利用率 | 0%(完全割裂) |

TensorFusion 方案

TensorFusion 通过GPU-over-IP技术和Kubernetes原生调度,完美解决了公安系统的四大痛点:

核心技术:数据不动,算力动

TensorFusion 的核心创新在于GPU-over-IP技术,实现了真正的"数据不动、算力动":

- GPU远程共享:通过IP网络(支持InfiniBand)将GPU算力远程共享,视频数据始终保留在本地辖区,算力通过网络调度到数据所在位置。

- 性能损失小于5%:经过深度优化的GPU-over-IP技术,性能损失控制在5%以内,完全满足实时推理的延迟要求。

- 零侵入部署:基于Kubernetes原生扩展,无需修改现有应用代码,只需添加注解即可接入。

解决方案一:跨辖区GPU池化,打破资源孤岛

- 统一资源池:将各辖区的GPU资源统一纳入TensorFusion资源池,实现跨辖区的算力共享。

- 智能调度:TensorFusion调度器实时感知各辖区的负载情况,自动将空闲辖区的GPU算力调度到高负载辖区。

- 资源隔离:通过GPU虚拟化技术,确保不同辖区的任务在共享GPU上完全隔离,互不干扰。

解决方案二:流水线推理,提升利用率

- 虚拟大卡:将多个空闲的GPU节点组合成虚拟大卡,支持大模型的流水线并行推理。

- 动态切分:根据任务需求动态切分GPU资源,小任务用小切片,大任务用大切片,最大化资源利用率。

- 超额订阅:通过GPU虚拟化和显存分层技术,支持GPU资源的超额订阅,进一步提升利用率。

解决方案三:优先级保障,确保关键任务

- 本地优先策略:当本地辖区有紧急任务时,远程共享的GPU算力会优雅退出,优先保障本地任务。

- 事件级调度:针对重大活动、突发事件,TensorFusion支持事件级策略调度,自动提升相关任务的优先级。

- SLA保障:通过策略化调度,确保实时告警任务始终获得足够的GPU资源,延迟稳定在SLA范围内。

解决方案四:Kubernetes原生,简化运维

- 零侵入集成:完全基于Kubernetes扩展实现,无需修改现有应用,只需在Pod上添加TensorFusion注解。

- 统一管理:通过TensorFusion控制台,统一管理所有辖区的GPU资源,简化运维。

- 自动扩缩容:支持基于GPU资源的自动扩缩容,根据负载自动调整资源分配。

实施亮点

- 合规保障:数据始终保留在本地辖区,算力通过网络调度,完全满足数据合规要求。

- 性能提升:通过GPU池化和智能调度,告警延迟从5-7秒降低到1.5秒,提升75%。

- 成本优化:GPU利用率从26%提升到68%,年度GPU成本降低42%。

- 弹性扩展:新增辖区或扩容时,只需接入TensorFusion资源池,无需重新采购硬件。

结果:优化前 vs 优化后

| 指标 | 优化前 | 优化后 | 变化 |

|---|---|---|---|

| 告警 P95 延迟 | 6 秒 | 1.5 秒 | 降低 75% |

| GPU 利用率 | 26% | 68% | 约 2.6× |

| 案件回溯排队时间 | 25 分钟 | 8 分钟 | 约 68% 更快 |

| 年度 GPU 成本 | 100% | 58% | 降低 42% |

| 跨辖区资源利用率 | 0%(割裂) | 35–45% | 从 0 到 35%+ |

| 使用 TensorFusion 前 | 使用 TensorFusion 后 |

|---|---|

| 数据必须留本地;各辖区 GPU 割裂;利用率约 26% | 数据留本地;通过 GPU-over-IP 跨辖区池化算力;利用率 68% |

| 高峰告警延迟 5–7 秒;案件回溯排队 20–30 分钟 | 告警 P95 1.5 秒;案件回溯 8 分钟;关键任务有优先级保障 |

| 各辖区按峰值配置;年度成本 100%;无法跨辖区共享 | 跨辖区池化;年度成本 58%;弹性扩展无需新采购 |

“重大活动期间告警延迟降到 2 秒以内,同时成本也下降。” — 公安信息化负责人

为什么适合政府场景

完美契合政府业务特点

公安业务的核心要求是数据主权与快速响应,这两个看似矛盾的需求,TensorFusion通过技术创新完美解决:

-

数据合规保障:

- 视频数据始终保留在本地辖区,绝不跨区域传输

- 通过GPU-over-IP技术,只有算力在网络中流动,数据完全不动

- 满足《数据安全法》、《个人信息保护法》等合规要求

-

快速响应能力:

- 跨辖区GPU池化,确保高峰期有足够的算力资源

- 优先级调度保障,关键任务始终优先执行

- 告警延迟从5-7秒降低到1.5秒,应急处置效率大幅提升

-

成本可控:

- GPU利用率提升2.6倍,从26%提升到68%

- 年度GPU成本降低42%,节省大量财政支出

- 统一管理降低运维成本,提升管理效率

-

技术先进性:

- Kubernetes原生,与现有基础设施无缝集成

- GPU虚拟化技术,实现真正的资源隔离和超额订阅

- 支持GPU-over-IP,性能损失小于5%,满足实时推理要求

相比传统方案的优势

| 对比项 | 传统方案 | TensorFusion方案 |

|---|---|---|

| 数据合规 | ✅ 数据不出辖区 | ✅ 数据不出辖区 |

| 资源利用率 | ❌ 22-30%(割裂) | ✅ 68%(池化) |

| 跨区域共享 | ❌ 不支持 | ✅ 支持(算力共享) |

| 高峰期延迟 | ❌ 5-7秒 | ✅ 1.5秒 |

| 成本优化 | ❌ 无法优化 | ✅ 降低42% |

| 运维复杂度 | ❌ 分散管理 | ✅ 统一管理 |

| 扩展性 | ❌ 需重新采购 | ✅ 弹性扩展 |

TensorFusion通过技术创新,在满足数据合规要求的前提下,实现了算力资源的跨区域共享,既保障了数据主权,又提升了响应速度,同时大幅降低了成本,是政府公共安全场景的理想解决方案。

更多文章

邮件列表

加入我们的社区

订阅邮件列表,及时获取最新消息和更新